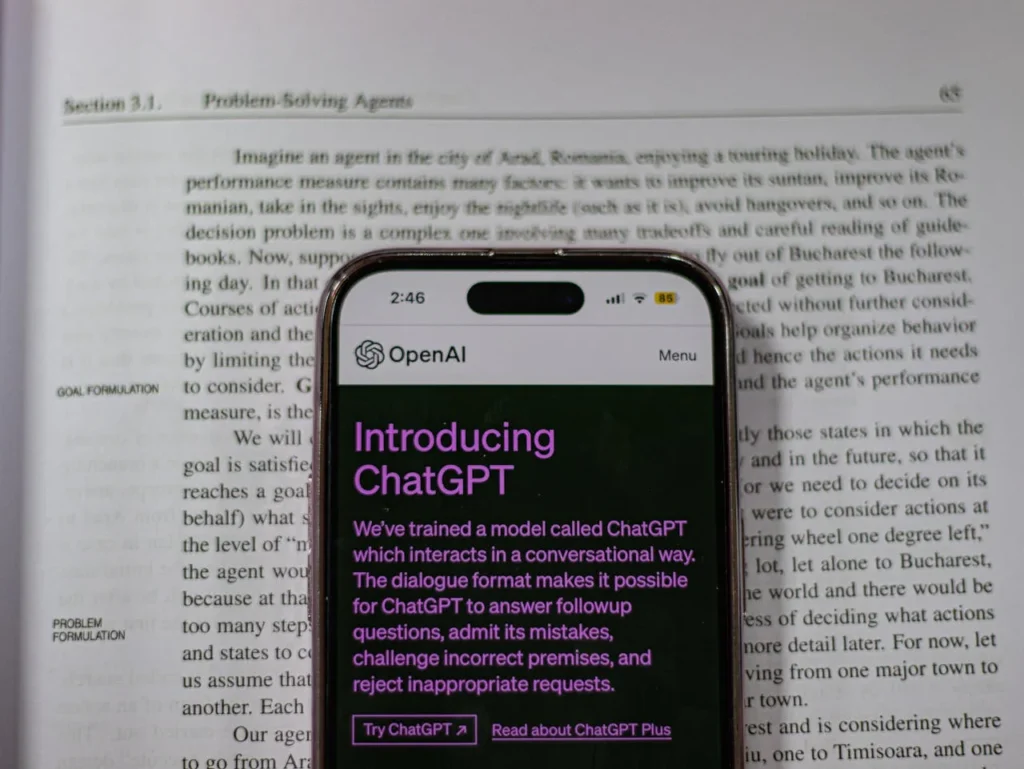

Últimamente he notado cómo cada vez más personas confían ciegamente en los resultados que les da Chat GPT o cualquier otra herramienta de inteligencia artificial, sin siquiera cuestionarlos. Es como si, de repente, la IA se hubiera convertido en la respuesta a todo, pero nadie se detiene a pensar en lo que realmente están haciendo. No me malinterpretes, soy un gran defensor de la tecnología y sus beneficios, pero hay algo que no puede hacer: la IA no remplazará el pensamiento crítico. Por muy avanzada que sea, no puede tomar decisiones morales, ni entender el contexto o los matices humanos que una máquina simplemente no percibe. Y ese es el peligro: delegar tareas sin usar nuestra capacidad de análisis, algo que, a largo plazo, afecta tanto a la calidad del trabajo como a nuestro propio desarrollo profesional.

El riesgo de la dependencia excesiva de la IA

El tema con la IA es que, aunque es una herramienta increíblemente poderosa, puede volverse un verdadero problema si empezamos a depender de ella para todo. Lo veo en todas partes, ya sea en programación, marketing o arquitectura. La gente empieza a usarla como si fuera la solución mágica para cada tarea, olvidando algo clave: no tiene la capacidad de interpretar un contexto complejo, ni de reflexionar sobre el impacto de una decisión. No tiene ese juicio humano que se basa en la experiencia, y eso es lo que hace la diferencia.

Cuando delegamos todo en la IA y no nos molestamos en revisar lo que genera, nos estamos perjudicando a nosotros mismo. A largo plazo, perdemos habilidades importantes. Ya sea escribiendo código, diseñando una campaña o resolviendo un caso legal, si no analizamos lo que estamos haciendo, esa dependencia se vuelve peligrosa. Al principio, puede parecer que todo va más rápido y que estamos siendo más productivos, pero en cuanto empiezan a surgir errores o problemas, te das cuenta de que el costo de no haber hecho una revisión adecuada es mucho mayor.

El impacto del uso irresponsable de la IA en la programación

Hace poco vi el caso del usuario @mayowaoshin, asesor de inteligencia artificial y emprendedor tecnológico, en la plataforma X. Este programador, con más de mil horas de experiencia utilizando Cursor AI, señaló algunos problemas críticos en su campo. Uno de los más comunes es que los códigos generados por la IA suelen tener errores sutiles. En un caso particular, el sistema no actualizaba correctamente el precio total cuando un producto era eliminado de la lista de compra, lo que podía causar cobros erróneos a los clientes.

Este tipo de problemas puede generar no solo pérdida de confianza, sino también demandas y gastos imprevistos para la empresa. El uso de IA en programación sin un proceso de revisión cuidadoso es como confiar ciegamente en un desarrollador junior que no entiende la lógica detrás del código. A largo plazo, estos pequeños errores pueden acumularse y causar serios problemas de funcionamiento en las aplicaciones.

Si bien la IA puede ser útil para agilizar procesos, la IA no remplazará el pensamiento crítico que requiere revisar, evaluar y entender la estructura completa de un proyecto. Depender solo de la tecnología, sin ese juicio humano, lleva a problemas que podrían haberse evitado con una simple revisión manual.

Mercadólogos que dejan todo el trabajo a la IA: el peligro de los copys y campañas automáticas

El marketing digital es otra área donde el uso irresponsable de la IA está afectando el trabajo de los profesionales. Muchos mercadólogos han caído en la trampa de dejar que genere automáticamente todo su contenido. Desde copys hasta campañas completas, algunas de estas creaciones automáticas pueden parecer impresionantes, pero suelen carecer del toque humano necesario para conectar verdaderamente con el público.

Cuando se confía ciegamente en herramientas como ChatGPT para generar contenido, se corre el riesgo de crear campañas que no capturan los matices emocionales ni las particularidades culturales de una audiencia. Las campañas de marketing que no toman en cuenta estos factores tienen más probabilidades de fracasar. Un ejemplo de ello es cuando una empresa lanza una campaña diseñada por IA sin revisar sus implicaciones culturales, resultando en un mensaje que ofende a un grupo específico. Si el profesional no interviene para adaptar el mensaje, la empresa puede perder credibilidad, e incluso clientes.

La IA no remplazará el pensamiento crítico en marketing, porque conectar con una audiencia requiere sensibilidad, empatía y creatividad, cosas que una máquina no puede proporcionar. Ésta puede ser una gran herramienta para analizar datos y tendencias, pero al final, el mensaje debe ser cuidadosamente revisado y adaptado por un ser humano.

Abogados que confían en la IA para resolver casos

En el ámbito legal, la IA se está utilizando para analizar documentos y redactar contratos, lo que sin duda puede ser muy útil en términos de eficiencia. No obstante, los abogados que dependen demasiado de estas herramientas corren el riesgo de pasar por alto cuestiones éticas y morales que solo un ser humano puede evaluar correctamente.

Uno de los grandes problemas de la IA en el derecho es el sesgo. Los sistemas aprenden a partir de datos, y si esos datos contienen sesgos raciales o de género, el sistema los replicará. Por ejemplo, supongamos que una IA utilizada para analizar antecedentes penales en un juicio subestimó la gravedad de los crímenes cometidos por hombres blancos en comparación con los hombres afroamericanos. En otro caso, la máquina podría recomendar sentencias más largas para mujeres de color basándose en datos históricamente sesgados.

Esto demuestra que, aunque la tecnología puede automatizar ciertos procesos en el derecho, la IA no remplazará el pensamiento crítico. Los abogados deben revisar con cuidado los resultados generados y aplicar su juicio ético para tomar decisiones justas y equilibradas.

El papel del pensamiento crítico en la era de la IA

El pensamiento crítico sigue siendo fundamental en esta era de la IA. Aunque estas herramientas pueden procesar grandes cantidades de información, organizar datos y generar análisis complejos, carecen de la capacidad para comprender el contexto completo de una situación o las consecuencias a largo plazo de una decisión.

La toma de decisiones basadas exclusivamente en los resultados generados por una máquina es peligrosa. La IA no remplazará el pensamiento crítico porque el juicio humano es lo que da valor real a una decisión. Los profesionales que combinan su uso con su capacidad de reflexión profunda, análisis de contexto y experiencia, son los que tendrán éxito en el futuro.

Cómo utilizar la IA de manera responsable en diferentes profesiones

El uso de IA puede ser extremadamente beneficioso si se utiliza de manera inteligente y responsable. Aquí algunos consejos prácticos:

- Revisión constante: No delegues completamente una tarea a la IA. Asegúrate de revisar cuidadosamente los resultados y de entender el proceso detrás de ellos.

- Capacitación continua: Aprende cómo funciona la IA en tu campo, para que puedas identificar rápidamente errores o limitaciones en los resultados que genera.

- Contexto humano: La IA es excelente procesando datos, pero el contexto humano siempre debe estar presente. Analiza los resultados generados y ajusta tus decisiones según el entorno y las implicaciones a largo plazo.

- Ética y responsabilidad: Especialmente en campos como el derecho o la medicina, donde las decisiones pueden tener graves consecuencias, es importante que los profesionales mantengan la responsabilidad ética de sus acciones. La IA puede asistir, pero el juicio final siempre debe ser humano.

Conclusión: La IA no reemplaza el juicio humano

La IA ha revolucionado muchas áreas de trabajo, pero no puede sustituir el pensamiento crítico humano. Desde la programación hasta el marketing y el derecho, los profesionales deben usar estas herramientas de manera responsable y como un complemento de sus habilidades, no como un remplazo. La clave está en encontrar el equilibrio: aprovechar las capacidades de la IA para mejorar la eficiencia, pero sin perder de vista el juicio humano, la ética y la creatividad. En última instancia, aquellos que sean capaces de combinar ambas habilidades serán los que prosperen en un futuro impulsado por la tecnología.

FAQs

¿Por qué la IA no puede remplazar el pensamiento crítico?

Porque el pensamiento crítico se basa en la capacidad humana de analizar situaciones complejas, tomar decisiones éticas y considerar factores contextuales que las máquinas no pueden entender.

¿Cuáles son los peligros de depender completamente de la IA en el trabajo?

El principal riesgo es perder habilidades críticas, como la capacidad de análisis profundo y el juicio humano. Esto puede llevar a errores que podrían evitarse si se revisan cuidadosamente los resultados de la IA.

¿Qué áreas profesionales se ven más afectadas por el mal uso de la IA?

Programación, marketing y derecho son tres de las áreas más afectadas. Los profesionales que no supervisan cuidadosamente los resultados generados por IA corren el riesgo de dañar sus proyectos o tomar decisiones equivocadas.

¿Cómo se puede usar la IA de manera responsable?

Revisando siempre los resultados generados por la IA, capacitando constantemente a los profesionales en el uso de estas herramientas y aplicando siempre el contexto humano y ético en la toma de decisiones.

¿Cuál es el papel del juicio ético en la IA?

El juicio ético sigue siendo exclusivamente humano. La IA no puede tomar decisiones basadas en valores morales, lo que es esencial en campos como el derecho o la medicina.